コンテンツ

Will Democracy Survive Big Data and Artificial Intelligence?

www.scientificamerican.com/article/will-democracy-survive-big-data-and-artificial-intelligence/

ByDirk Helbing,Bruno S. Frey,Gerd Gigerenzer,Ernst Hafen,Michael Hagner,Yvonne Hofstetter,Jeroen van den Hoven,Roberto V. Zicari,Andrej Zwitter on.

編集部注:この記事は、Scientific Americanの姉妹誌であるSpektrum der Wissenschaftに「Digitale Demokratie statt Datendiktatur 」として初めて掲載されたものである。

「悟りとは、人間が自ら課した未熟さから抜け出すことである。未熟とは、他者からの指導なしに自分の理解を使うことができないことである」

-イマヌエル・カント 「啓蒙とは何か?」(1784)

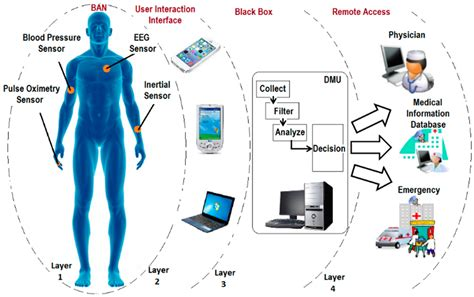

デジタル革命が本格化。それは私たちの世界をどう変えていくのだろうか。私たちが生み出すデータの量は、毎年2倍になっている。言い換えれば 2016年に私たちは2015年までの人類の全歴史と同じ量のデータを生産した。毎分、私たちは何十万ものGoogle検索やFacebook投稿を生み出している。これらには、私たちがどう考え、どう感じているかを明らかにする情報が含まれている。やがて、私たちの身の回りのもの、もしかしたら衣服までもが、インターネットに接続されるようになるかもしれない。10年後には、ネットワークにつながった計測センサーの数は、地球上の人の20倍、1,500億個になると言われている。そして、そのデータ量は12時間ごとに2倍になると言われている。すでに多くの企業が、このビッグデータをビッグマネーに変えようとしている。

スマートフォンだけでなく、スマートホーム、スマートファクトリー、スマートシティなど、あらゆるものがインテリジェント化されるだろう。スマートフォンだけでなく、スマートホーム、スマートファクトリー、スマートシティが実現し、スマートな国家、スマートな地球が生まれると期待すべきだろうか。

人工知能の分野は、実に目覚ましい発展を遂げている。特に、データ解析の自動化に貢献している。人工知能は、もはや一行一行のプログラムではなく、学習することで継続的に進化することが可能になっている。最近では、グーグルのDeepMindアルゴリズムが、アタリゲーム49勝の方法を自ら学習した。アルゴリズムは、手書きの言語やパターンを人間とほぼ同じように認識できるようになり、ある種のタスクでは人間よりうまくこなすことさえできる。写真やビデオの内容を記述することもできる。今日、金融取引の70%はアルゴリズムによって行われている。ニュースの内容も、一部は自動生成されている。今後10~20年の間に、現在の仕事の約半分がアルゴリズムに脅かされることになるだろう。今日のトップ500企業の40%は、10年以内に消滅してしまうだろう。

2020年から2060年にかけて、スーパーコンピュータがほとんどすべての分野で人間の能力を超えることが予想される。専門家たちは警鐘を鳴らし始めている。テスラモーターズのイーロン・マスク、マイクロソフトのビル・ゲイツ、アップルの共同創業者スティーブ・ウォズニアックなど、テクノロジーの先見者たちは、超知能は人類にとって深刻な危険であり、核兵器よりも危険かもしれないと警告している。

これは警鐘か?

ひとつだけはっきりしていることは、経済と社会のあり方が根本的に変わるということだ。私たちは今、第二次世界大戦後最大の変革を経験している。生産の自動化、自動運転車の誕生に続き、次は社会の自動化が起ころうとしている。このように、社会は大きなチャンスと同時に大きなリスクももたらす岐路に立たされている。もし、間違った決断をすれば、我々の歴史的な偉業が脅かされるかもしれない。

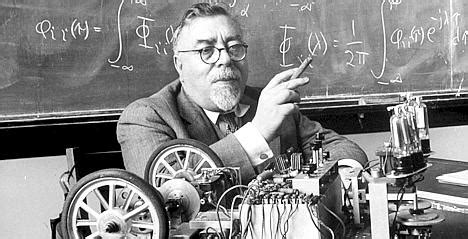

1940年代、アメリカの数学者、ノーバート・ウィーナー(1894-1964)は、サイバネティクスを提唱した。彼は、システムの振る舞いは、適切なフィードバックによって制御できるとした。すぐに、この基本原理に従って経済や社会をコントロールすることを想像する研究者が現れたが、当時は必要な技術がなかった。

今日、シンガポールはデータ管理社会の完璧な例と見なされている。テロから国民を守るために始めたプログラムが、経済や移民政策、不動産市場、学校カリキュラムに影響を与えるに至っている。中国も同じような道を歩んでいる。最近、中国のGoogleに相当するBaiduは、China Brain Projectに参加するために軍を招待した。これは、ユーザーについて収集した検索エンジンのデータに対して、いわゆるディープラーニングアルゴリズムを実行するというものだ。この先には、一種の社会統制も計画されている。最近の報道によると、すべての中国国民はいわゆる「市民スコア」を取得し、どのような条件でローンや仕事、他国への旅行ビザを取得できるかを決定することになるそうである。このような個人モニタリングには、人々のネットサーフィンや社会的接触の行動が含まれる(「Spotlight on China」参照)。

消費者はますます頻繁に行われる信用調査に直面し、一部のオンラインショップでは個人向け価格の実験が行われるなど、欧米では同様の道を歩んでいる。また、私たちは皆、制度的なモニタリングの焦点の中にいることがますます明らかになっている。これは 2015年にイギリスのシークレットサービスの「カルマポリス」プログラムの詳細が公開され、すべての人のインターネット利用を包括的にスクリーニングしていることが明らかになったことで、明らかになった。ビッグブラザーは今、現実のものとなりつつあるのだろうか。

プログラムされた社会、プログラムされた市民

すべては、ごく無害に始まった。検索エンジンやレコメンデーションプラットフォームは、私たちにパーソナライズされた製品やサービスを提案するようになった。この情報は、過去の検索、購入、移動行動、社会的相互作用から収集された個人情報とメタデータに基づいている。公式にはユーザーの身元は保護されているが、実際にはかなり容易に推測することができる。今日、アルゴリズムは、私たちが何をし、何を考え、どう感じているのか、おそらく友人や家族、さらには私たち自身よりもよく知っている。友人や家族、あるいは自分自身よりもよく理解していることもある。実際、私たちはこのようにして、これまで以上にうまく遠隔操作されているのである。私たちのことを知れば知るほど、私たちの選択が自由で、他者によって決定されたものでなくなる可能性は低くなる。

しかし、それだけでは終わらない。一部のソフトウェア・プラットフォームは、「説得力をもつコンピューティング 」に向かっている。将来、これらのプラットフォームは、高度な操作技術を使って、複雑な作業プロセスの実行や、企業が数十億ドルを稼ぐインターネットプラットフォーム用の無料コンテンツの生成など、行動全体の流れを誘導することができるようになるだろう。 コンピュータのプログラミングから、人間のプログラミングへ。

このような技術は、政治の世界でもますます普及しつつある。「ナッジング」というラベルのもと、政府は大規模に、「ナッジ」-現代のパターナリズムの一形態-によって、市民をより健康に、あるいはより環境にやさしい行動へと導こうとしている。新しい、人道的政府は、我々が何をするかに興味があるだけでなく、正しいと思われることをするように仕向けたいのである。この魔法の言葉は、ビッグデータとナッジングの組み合わせである「ビッグナッジング」である。多くの人にとって、これは、民主的なプロセスに市民を巻き込むことなく、大衆を効率的に統治できる一種のデジタルセプターのように見える。これは、既得権益を克服し、世の中の流れを最適化することができるのだろうか?もしそうなら、市民はデータから力を得た「賢王」によって統治され、まるでデジタルな魔法の杖を使っているかのように、望ましい経済的・社会的成果を生み出すことができるようになるかもしれない。

あらかじめプログラムされた大惨事

しかし、関連する科学文献を一読すると、意見を「最適化」という意味でコントロールしようとする試みは、問題の複雑さゆえに失敗する運命にあることがわかる。意見の形成の力学は驚きに満ちている。デジタルな魔法の杖、つまり操作的なナッジング技術をどう使うのがベストなのか、誰も知らない。何が正解で、何が間違いだったかは、後になってからわかることが多い。例えば 2009年にドイツで豚インフルエンザが流行したとき、誰もがワクチン接種を受けるように勧められた。ところが、予防接種を受けた人のうち一定の割合で、ナルコレプシーという珍しい病気にかかったことが分かった。幸いなことに、予防接種を選択した人が増えなかった。

また、最近、健康保険会社が国民の心血管疾患を減らすために、スマートフィットネスブレスレットを配布して運動を奨励しようとしているが、結局は股関節の手術が増えるかもしれない。社会のような複雑なシステムでは、ある部分を改善すると、必ず別の部分が悪化する。このように、大規模な介入は時に大きな過ちとなることがある。

それにもかかわらず、犯罪者やテロリスト、過激派は、遅かれ早かれデジタル魔法の杖を支配しようとするだろう-おそらく、私たちが気づかないうちに。ペンタゴン、ホワイトハウス、NSAに至るまで、ほとんどすべての企業や組織がすでにハッキングされている。

さらに、十分な透明性と民主的統制が欠けている場合には、内部からのシステムの侵食という問題が発生する。検索アルゴリズムや推薦システムは影響を受ける可能性がある。企業は、より有利な結果を得るために、特定の言葉の組み合わせに入札することができる。政府もおそらく結果に影響を与えることができるだろう。選挙では、支持を決めかねている有権者を支持するように仕向けるかもしれない。つまり、この技術を操る者は、自らを権力者に仕立て上げ、選挙に勝利することができるのだ。

この問題は、多くの国で、単一の検索エンジンやソーシャルメディアプラットフォームが圧倒的な市場シェアを持っているという事実によって悪化している。国民に決定的な影響を与え、これらの国に遠隔操作で干渉する可能性がある。2015年10月6日に下された欧州司法裁判所の判決により、欧州のデータの無制限な輸出が制限されたとはいえ、根本的な問題は欧州内ではまだ解決されておらず、それ以外の地域ではなおさらである。

どのような副作用があるのだろうか?操作に気づかれないようにするためには、いわゆる共鳴効果、つまり一人ひとりに合わせて十分にカスタマイズされた提案が必要だ。そうすると、ローカルなトレンドが繰り返されることで次第に強化され、「フィルターバブル」あるいは「エコーチェンバー効果」と呼ばれる、自分の意見ばかりが反映されるようになってしまうのである。そうなると社会は分極化し、互いに理解し合えなくなったグループが形成され、対立が激化する。このように、パーソナライズされた情報は、意図せずして社会の結束を崩してしまうことがある。現在、アメリカの政治では、民主党と共和党の離反が進み、政治的妥協がほとんど不可能になっている。その結果、社会は分断され、もしかしたら崩壊してしまうかもしれない。

共鳴効果によって、社会の大規模な意見の変化は、ゆっくり、少しずつしか生まれない。タイムラグがある一方で、簡単に元に戻すことはできない。例えば、マイノリティや移民に対する憤りが制御不能になり、行き過ぎた国民感情が差別や過激派、紛争を引き起こす可能性がある。

おそらくもっと重要なのは、操作的な方法は、私たちの意思決定の方法を変えてしまうという事実だ。少なくとも一時的には、文化的・社会的な手がかりを上書きしてしまうのである。まとめると、操作的手法の大規模な使用は、デジタル世界における行動の残忍化など、深刻な社会的損害を引き起こす可能性があるということだ。誰がこの責任を負うべきなのだろうか?

法的課題

このことは、ここ数年のタバコ会社、銀行、IT企業、自動車会社に対する巨額の制裁金を考えると、無視できない法的問題を提起している。しかし、どのような法律に違反する可能性があるとすれば、それはどのようなものだろうか。まず、操作可能な技術が選択の自由を制限することは明らかである。もし、私たちの行動の遠隔操作が完璧に機能するとしたら、私たちは本質的にデジタル奴隷になってしまうだろう。なぜなら、私たちは、以前に他者によって実際になされた決定しか実行できないからだ。もちろん、操作系技術は部分的にしか有効ではない。とはいえ、私たちの自由はゆっくりと、しかし確実に失われつつある。実際、これまでのところ、人々の抵抗がほとんどないほどゆっくりと消えている。

ここで、偉大な啓蒙家イマニュエル・カントの洞察が大いに関係するように思われる。特に彼は、国民の幸福を決定しようとする国家は専制君主であると指摘している。しかし、個人の自己啓発の権利は、自分の人生をコントロールできる人だけが行使できるものであり、それは情報的自己決定を前提にしている。これは、私たちの最も重要な憲法上の権利にほかならない。民主主義は、これらの権利が尊重されない限り、うまく機能しない。もし、これらの権利が束縛されれば、憲法、社会、国家が弱体化する。

ビッグナッジなどの操作技術はパーソナライズド広告と同様の機能を持つため、他の法律も影響を受ける。広告は、その旨を表示しなければならず、誤解を招くようなものであってはならない。また、サブリミナル刺激など、特定の心理的トリックを利用することも禁じられている。映画の中で一瞬だけ清涼飲料水を映し出すことが禁止されているのも、そのためだ。その場合、広告が意識的に認識されることはないが、潜在的な影響を与える可能性があるからだ。さらに、現在広く行われている個人情報の収集と処理は、欧州諸国やその他の国で適用されているデータ保護法に適合していないことは確かである。

最後に、個人別価格の適法性については、インサイダー情報の悪用となる可能性があるため、疑問が残る。その他にも、平等と非差別の原則や、自由な市場アクセスと価格の透明性が保証されなくなったことによる競争法への違反の可能性もある。このような状況は、他の国で製品を安く売っているにもかかわらず、その国を経由した購入を防ごうとする企業に匹敵する。このようなケースは、過去に高額の罰金につながったことがある。

パーソナライズされた広告や価格は、古典的な広告や割引クーポンとは比較にならない。後者は非特異的であり、また、人間の心理的弱点に付け込み、批判的思考を打ちのめすことを目的としてプライバシーを侵害しない。

さらに忘れてはならないのは、学問の世界では、たとえ無害な意思決定実験であっても、人を対象とした実験とみなされ、公的な責任を持つ倫理委員会の承認が必要とされることだ。その際には、必ず関係者のインフォームドコンセントが必要だ。これに対して、(最近の多くの情報プラットフォームがそうであるように)100ページにも及ぶ「利用規約」の内容に同意するかどうかを確認するためのワンクリックは、実に不十分である。

それにもかかわらず、ナッジングのような操作技術を使った実験が、何百万人もの人々に知らせず、透明性もなく、倫理的な制約もなく行われているのである。Facebookのような大規模なソーシャルネットワークやOkCupidのようなオンラインデーティングプラットフォームでさえ、すでにこの種の社会実験を行ったことを公に認めている。もし私たちが人間や社会に関する無責任な研究を避けたいのであれば(最近の拷問スキャンダルへの心理学者の関与を考えてみてほしい)、高い基準、特に科学的品質基準やヒポクラテスの誓いのような行動規範を課すことが緊急に必要なのである」 私たちの思考、自由、民主主義はハッキングされてしまったのだろうか?

仮に、神のような知識と超人的な能力を持つ超知性的な機械があったとしたら、その指示に従うだろうか?これは可能なように思える。しかし、もしそうなったら、イーロン・マスク、ビル・ゲイツ、スティーブ・ウォズニアック、スティーブン・ホーキングなどが表明した警告が現実のものとなり、コンピューターが世界を支配することになるだろう。超知能は間違いを犯し、嘘をつき、利己的な利益を追求し、操られる可能性もあることをはっきりさせておかなければならない。そして何より、超知能は全人類の分散した集合知とは比較にならない。

すべての市民の思考をコンピュータクラスタに置き換えるという考えは、実現可能な解決策の多様性と質を劇的に低下させることになり、不合理だ。データがあふれ、個人化された情報が使われるようになっても、世界の問題が減らないことは、すでに明らかである。世界平和はもろい。気候の長期的な変化は、恐竜の絶滅以来の種の喪失につながる可能性がある。また、金融危機とその経済への影響も克服するには程遠い状況だ。サイバー犯罪は、年間3兆ドルの損失をもたらすと推定されている。国家やテロリストはサイバー戦争に備えつつある。

急速に変化する世界では、スーパーインテリジェンスが完璧な判断を下すことはできない(図1参照)。システムの複雑さはデータ量よりも速く増加し、そのデータ量は処理能力を上回り、データ転送速度も制限されている。その結果、良い解決策を導き出すために重要なローカルな知識や事実が無視されることになる。特に、挙動が大きく変動し、ほとんど予測できず、リアルタイムでの最適化が不可能な複雑なシステムでは、分散型の局所制御法が集中型のアプローチより優れていることが多い。これは、都市における交通制御にも言えることだが、高度にネットワーク化され、グローバル化した世界の社会・経済システムにおいては、なおさらだろう。

さらに、強力なアルゴリズムによる意思決定の操作は、複雑な世界の課題に柔軟に対応できる「集合知」の基盤を損なう危険性がある。集合知が機能するためには、個人による情報検索と意思決定が独立して行われる必要がある。しかし、私たちの判断や決断がアルゴリズムによってあらかじめ決められているとしたら、それはまさに人々の洗脳につながる。知的な存在が、単なるコマンドの受信者に格下げされ、刺激に自動的に反応するようになるのだ。

つまり、パーソナライズされた情報は、私たちの周りに「フィルターバブル」を作り、私たちの思考のためのデジタルな牢獄のようなものなのである。このような状況下で、創造性や「既成概念にとらわれない」思考が可能なわけがないだろう。結局のところ、超知的情報システムによるテクノクラート的な行動・社会統制の中央集権システムは、新しい形の独裁に帰結する。したがって、「リベラル・パターナリズム」の旗印の下にあるトップダウン型の管理社会は、原理的にはバラ色の表紙をつけた全体主義体制にほかならないのである。

実際、ビッグ・ナッジングは、多くの人々の行動を一致させ、彼らの視点と決定を操作することを目的としている。これは、プロパガンダや、行動制御による市民の標的型無力化の分野に位置づけられる。特に、前述した文化を損なう効果を考慮すると、長期的には致命的な結果になることが予想される。

より良いデジタル社会は可能だ

激しいグローバル競争にもかかわらず、民主主義国家は何世紀にもわたる成果を海に投げ捨てない方が賢明であろう。他の政治体制とは対照的に、西欧の民主主義国家には、すでに多元主義や多様性に対処する術を身につけているという利点がある。あとは、それらをより生かす方法を学ぶだけである。

将来的には、企業、政府、市民の間で健全なバランスが保たれている国がリードすることになるだろう。そのためには、ネットワーク型の思考と、情報、イノベーション、製品、サービスの “エコシステム” の確立が必要だ。うまく機能させるためには、参加の機会を設けるだけでなく、多様性を支援することも重要だ。なぜなら、最適な目標機能を決める方法がないからである。一人当たりの国民総生産を最適化するべきか、持続可能性を最適化するべきか?権力か平和か?幸福か平均寿命か?一人当たりの国民総生産を最適化すべきか、それとも持続可能性か、権力か平和か、幸福か寿命か。様々な異なる目標の追求を可能にすることで、多元的な社会は、これから起こる様々な予想外の課題に対処することができるようになるのである。

中央集権的なトップダウン制御は過去の解決策であり、複雑性の低いシステムにしか適さない。したがって、連邦制と多数決が現在の解決策である。経済的・文化的進化に伴い、社会の複雑性は高まり続けるだろう。したがって、これからの解決策は集合知だ。つまり、市民科学、クラウドソーシング、オンライン・考察・プラットフォームは、より多くの知識、アイデア、リソースを利用可能にするための極めて重要な新しいアプローチなのである。

集団的知性には高度な多様性が必要だ。しかし、今日のパーソナライズされた情報システムによって、トレンドが強化され、これは減少している。

社会多様性は、生物多様性と同じくらい重要だ。社会多様性は、集合知やイノベーションだけでなく、予期せぬショックに対処する社会の能力であるレジリエンス(回復力)も促進する。社会多様性の低下は、しばしば経済や社会の機能性やパフォーマンスを低下させる。全体主義的な政権がしばしば近隣諸国と対立してしまうのはこのためである。典型的な長期的帰結は、歴史上幾度となく起こったように、政情不安と戦争である。したがって、多元主義と参加は、主として市民に対する譲歩としてではなく、繁栄する複雑な現代社会の機能的な前提条件と見なされるべきなのである。

まとめると、私たちは今、岐路に立たされていると言えるだろう(図2参照)。ビッグデータ、人工知能、サイバネティクス、行動経済学などが、良くも悪くも我々の社会を形成している。このような技術の普及は、社会のコアバリューと相容れない場合、遅かれ早かれ甚大な被害をもたらすだろう。全体主義的な自動化社会が到来する可能性もある。最悪の場合、中央集権的な人工知能が、私たちが何を知り、何を考え、どう行動するかを支配することになるだろう。私たちは今、デジタル革命の恩恵を受けられるような正しい道を選択しなければならない歴史的な瞬間にいるのである。そこで、私たちは以下の基本原則を遵守することを強く求める。

- 1.情報システムの機能をますます分散化すること。

- 2. 情報の自己決定と参加を支援すること。

- 3. より高い信頼性を得るために、透明性を向上させること。

- 4.情報の歪みと汚染を減らすこと。

- 5. ユーザーが管理する情報フィルタを有効にする。

- 6. 社会的・経済的な多様性を支援すること。

- 7. 相互運用性と協力の機会を向上させること。

- 8.デジタルアシスタントやコーディネートツールを作成する。

- 9.集合知を支援するために、そして

- 10. デジタルリテラシーと啓蒙活動を通じて、デジタル社会における市民の責任ある行動を促進すること。

このデジタル・アジェンダに従えば、経済、政府、市民など、すべての人々がデジタル革命の果実から利益を得ることができる。私たちは何を待っているのだろうか。

デジタル時代の戦略

ビッグデータと人工知能は、間違いなく重要なイノベーションである。これらは、個別化医療から持続可能な都市まで、経済的価値と社会の進歩を触媒する膨大な可能性を持っている。しかし、これらの技術を利用して市民を無力化することは、全く容認できない。ビッグ・ナッジングやシチズン・スコアは、中央で収集された個人データを全体主義的な方法で行動制御のために乱用するものである。これは、人権や民主主義の原則と相容れないだけでなく、現代の革新的な社会を運営する上でも不適切である。世界の真の問題を解決するためには、情報とリスクマネジメントの分野ではるかに優れたアプローチが必要である。責任あるイノベーションの研究領域とイニシアチブ「Data for Humanity」(「社会と人類のためのビッグデータ」参照)は、ビッグデータと人工知能を社会のためにどう使うべきかという指針を与えてくれる。

今、私たちにできることは何だろうか。まず、デジタル革命の時代であっても、市民の基本的な権利は、現代の機能的で民主的な社会の基本的な前提条件であるため、保護されるべきである。そのためには、市民や顧客を障害物や搾取される資源としてではなく、パートナーとしてとらえ、信頼と協力に基づいた新しい社会契約を構築することが必要だ。そのためには、国家が適切な規制の枠組みを提供し、テクノロジーが民主主義に適合するように設計され使用されることを保証する必要がある。これは、理論的にだけでなく、実際的にも、情報的自己決定を保証しなければならない。なぜなら、自己決定と責任ある方法で人生を送るためには、それが前提条件となるからである。

また、私たちに関して収集された個人データのコピーを入手する権利も必要である。この情報は、標準化されたフォーマットで、個人データストアに自動的に送信されなければならないと法律で規定されるべきで、このストアを通じて、個人は自分のデータの使用を管理できる(特定のAIベースのデジタルアシスタントによってサポートされる可能性がある)。プライバシーを確保し、差別を防ぐために、データの不正利用は法律で罰せられなければならない。そうすれば、自分の情報を誰が、どのような目的で、どれくらいの期間利用できるかを個人が決定できるようになる。さらに、データが安全に保管され、交換されることを保証するために、適切な措置が講じられるべきである。

複数の基準を考慮した洗練されたレピュテーションシステムは、私たちの意思決定のベースとなる情報の質を高めるのに役立つだろう。データフィルタや推薦・検索アルゴリズムがユーザーによって選択・設定可能であれば、問題を多面的に見ることができ、歪んだ情報による操作を受けにくくなる。

さらに、市民のための効率的な苦情処理手続きと、ルール違反に対する効果的な制裁が必要である。最後に、十分な透明性と信頼を生み出すために、主要な科学機関は、現在民主的な統制から逃れているデータとアルゴリズムの受託者として行動すべきである。そのためには、少なくとも機密性の高いデータやアルゴリズムにアクセスする者が遵守しなければならない適切な行動規範(IT専門家にとってのヒポクラテスの誓いのようなもの)も必要だろう。

さらに、新たな雇用とデジタル社会の未来のための基礎を築くために、デジタルアジェンダが必要だ。毎年、私たちは農業分野や公共インフラ、学校、大学などに数十億ドルを投資しているが、これは産業界やサービス業に利益をもたらすものである。

では、デジタル社会を成功させるためには、どのような公的制度が必要なのだろうか。まず、まったく新しい教育コンセプトが必要だ。標準化された労働者(将来的にはロボットやコンピューターアルゴリズムに仕事を奪われる)を作ることよりも、批判的思考、創造性、発明性、起業家精神に焦点を当てたものであるべきである。また、教育では、デジタル技術の責任ある重要な利用法についても理解させる必要がある。なぜなら、市民はデジタル世界が物理的な世界とどのように絡み合っているかを認識しなければならないからである。効果的かつ責任ある権利行使のために、市民はこれらの技術について理解する必要があるが、同時にどのような使い方が違法であるかについても理解しなければならない。だからこそ、科学、産業、政治、教育機関がこの知識を広く提供することがより一層必要なのである。

第二に、人々が自営業者になり、自分のプロジェクトを立ち上げ、コラボレーションパートナーを見つけ、製品やサービスを世界中に売り込み、リソースを管理し、税金や社会保障費を支払うことを容易にする参加型プラットフォームが必要だ(一種の万人のためのシェアリングエコノミー)。これを補完するために、町や村でも、新興のデジタルコミュニティーのためのセンター(ファブラボなど)を設立し、そこでアイデアを無料で共同開発し、テストすることができるようにすることができる。このようなセンターで見られるオープンで革新的なアプローチのおかげで、大規模で協力的なイノベーションが促進される可能性がある。

特定の種類のコンペティションは、イノベーションのための追加的なインセンティブを提供し、世間の認知度を高め、参加型デジタル社会への機運を醸成するのに役立つだろう。特に、市民社会を動員して、グローバルな問題解決にローカルに貢献する(例えば、「気候オリンピック」によって)のに有効である。例えば、希少な資源を調整するためのプラットフォームは、まだほとんど活用されていない循環型経済や共有経済の大きな可能性を解き放つのに役立つだろう。

オープンデータ戦略へのコミットメントにより、政府と産業界は、科学と公共の利用のためにデータをますます利用可能にし、私たちの世界の課題に対応する効率的な情報とイノベーションの生態系に適した条件を作り出すことができる。これは、いくつかの国で環境に優しい技術の使用に対して認められているのと同じように、減税によって促進されるかもしれない。

第三に、市民が運営する「デジタル神経システム」を構築することで、誰もがモノのインターネットの新しい可能性を開き、誰もが利用できるリアルタイムのデータ計測を提供することができる。資源をより持続可能な方法で利用し、気候変動を遅らせたいのであれば、他者や環境との相互作用がもたらすプラスとマイナスの副作用を測定する必要がある。適切なフィードバックループを用いることで、システムが自己組織化によって望ましい結果を達成するように影響を与えることができるだろう。

そのためには、すべての経済的、政治的、社会的イノベーターが利用できる、さまざまなインセンティブと交換システムが必要だ。これによって、全く新しい市場が生まれ、新しい繁栄の基盤ができる。デジタル経済の無限の可能性を引き出すには、多元的な金融システム(例えば、機能的に分化した通貨)と発明の対価に関する新しい規制が大いに役立つだろう。

複雑で多様な未来の世界にうまく対応し、それを利点に変えるために、私たちはパーソナルデジタルアシスタントを必要とするようになるだろう。このデジタルアシスタントは、人工知能の分野での発展からも恩恵を受けるだろう。将来は、人間と人工知能を組み合わせた数多くのネットワークが、必要に応じて柔軟に構築・再構築されることが予想される。しかし、私たちが生活をコントロールするためには、これらのネットワークを分散的に制御する必要がある。特に、ログインとログアウトが自在にできることも必要だろう。

民主党のプラットフォーム

ウィキペディア・オブ・カルチャーズ(Wikipedia of Cultures)」は最終的に、非常に多様な世界におけるさまざまな活動を調整し、互いに互換性を持たせるのに役立つだろう。それは、世界の文化の暗黙の成功原則を明示し、それらを新しい方法で結合することができるようになる。このような「文化ゲノムプロジェクト」は、社会文化の多様性の価値を世に知らしめるという意味で、一種の平和プロジェクトでもある。グローバル企業では、同質的なチームよりも文化的に多様で学際的なチームの方が成功することは以前から知られていた。しかし、多くの人が持つ知識やアイデアを効率的に集約し、集合知を生み出すために必要なフレームワークは、まだ多くの場所で欠けている。これを変えるには、オンライン審議プラットフォームの提供が非常に有効である。また、市民の参加機会を増やし、よりグレードアップしたデジタル民主主義を実現するために必要な枠組みを作ることもできる。今日の世界が直面している問題の多くは、市民社会からの貢献によってのみ対処できるものであるため、これは重要なことだ。

さらに読む

ACLU。中国の信用スコアシステム「Orwellian Citizen Score」は、アメリカ人への警告である …www.computerworld.com/article/2990203/security/aclu-orwellian-citizen-score-chinas-credit-score-syst

ビッグデータ、ビッグブラザーに出会う。中国、デジタル全体主義国家を構築。その社会信用プロジェクトがもたらす憂慮すべき影響。エコノミスト』(2016年12月17日号)。

ハリス、S.ソーシャル・ラボラトリー、フォーリン・ポリシー(2014年7月29日)、http://foreignpolicy.com/2014/07/29/the-social-laboratory/

Tong, V.J.C. Predicting how people think and behave, International Innovation, www.internationalinnovation.com/predicting-how-people-think-and-behave/.

Volodymyr, M., Kavukcuoglu, K., Silver, D., et al.。 深層強化学習による人間レベルの制御。In:Nature, 518, S. 529-533, 2015.

Frey, B. S. und Gallus, J.:Beneficial and Exploitative Nudges (有益なナッジと搾取的なナッジ).において。ヨーロッパ法学における法の経済分析。シュプリンガー 2015 年。

Gigerenzer, G.: リバタリアン・パターナリズムの根拠について。In:Review of Philosophy and Psychology 6(3), S. 361-383, 2015.

Grassegger, H. and Krogerus, M. Ich habe nur gezeigt, dass es die Bombe gibt[私は爆弾が存在することを示しただけだ]。Das Magazin (3. Dezember 2016) www.dasmagazin.ch/2016/12/03/ich-habe-nur-gezeigt-dass-es-die-bombe-gibt/

Hafen, E., Kossmann, D. und Brand, A.:Health Data Cooperatives-citizen empowerment.In:医学における情報の方法 53(2), S. 82-86, 2014.

Helbing, D.:The Automation of Society Is Next:デジタル革命をどう生き抜くか。クリエイトスペース,2015.

Helbing, D.:Thinking Ahead-Essays on Big Data, Digital Revolution, and Participatory Market Society.シュプリンガー,2015.

Helbing, D. und Pournaras, E.: デジタル・デモクラシーの構築.In:ネイチャー 527, S. 33-34, 2015.

van den Hoven, J., Vermaas, P.E. und van den Poel, I.:Handbook of Ethics, Values and Technological Design(倫理、価値観、技術設計ハンドブック).シュプリンガー, 2015.

Zicari, R. und Zwitter, A.:Data for Humanity:An Open Letter.フランクフルト・ビッグデータ・ラボ 2015.07.13.Zwitter, A.: Big Data Ethics.In:Big Data & Society 1(2), 2014.

図1:デジタルの成長出典Dirk Helbing

図1:デジタルの成長出典Dirk Helbing

ビッグデータのおかげで、私たちはより良い、根拠に基づいた意思決定を行うことができるようになった。しかし、ネットワーク化の進展に伴い、社会の複雑性が爆発的に増大するため、トップダウンによる制御の原則はますます通用しなくなる。分散制御のアプローチは、今後ますます重要になるだろう。集合知によってのみ、私たちの世界が直面する複雑な課題に対する適切な解決策を見出すことができる。

図2:デジタルの岐路に立つ。出典Dirk Helbing

図2:デジタルの岐路に立つ。出典Dirk Helbing

私たちの社会は今、岐路に立たされている。もし、これまで以上に強力なアルゴリズムが少数の意思決定者によってコントロールされ、我々の自己決定が減少するならば、我々は封建主義2.0に逆戻りし、重要な歴史的成果が失われることになるであろう。しかし、今、私たちはデジタルデモクラシーやデモクラシー2.0への道を選ぶチャンスがある。それは私たち全員に利益をもたらすだろう(https://vimeo.com/147442522 も参照)。

中国にスポットライトを当てる。これからの社会はこうなる?

行動や社会のコントロールは、私たちの生活にどのような影響を与えるのだろうか。現在中国で実施されている「市民スコア」のコンセプトがヒントになる。そこでは、すべての国民が一次元のランキング尺度で評価される。彼らが行うすべての行為にプラスまたはマイナスのポイントが与えられる。これは大量モニタリングを目的としているだけではない。個人のインターネット上でのクリック数や政治的に正しいかどうかによって点数が決まり、信用条件や特定の仕事へのアクセス、旅行ビザなどが決定されるのである。したがって、シチズン・スコアは行動と社会的統制に関するものである。友人や知人の行動までもがこのスコアに影響する。つまり、一族責任の原則も適用される。誰もが徳の守護者であると同時に、一種の詮索好きな情報提供者となり、異端的思想家は隔離されるのである。民主主義国家で同様の原則が広まった場合、ルールを決めるのが国家であろうと有力企業であろうと、結局は関係ないことになる。どちらの場合も、民主主義の柱が直接的に脅かされることになる。

- デジタル痕跡を残すすべての活動の追跡と測定は、「裸の」市民を生み出し、その人間的尊厳とプライバシーは徐々に低下していくだろう。

- なぜなら、ポイントシステムの基準を定めている政府や企業の立場からすると、間違った選択をすると悪い結果を招くからである。個人の自律性は原則的に失われる。

- 小さなミスが罰せられ、誰も疑わなくなる。推定無罪の原則は時代遅れになるだろう。Predictive Policingは、起きていないけれども、起きると予想される違反行為に対して罰せられる可能性さえある。

- アルゴリズムに誤りがないとは言い切れないので、公平と正義の原則は、新しい種類の恣意性に取って代わられ、それに対して人々はほとんど自己防衛することができないだろう。

- 個人の目標が外部に設定されれば、個人の自己啓発の可能性はなくなり、それによって民主的多元主義もなくなる。

- 地域の文化や社会規範は、もはや状況に応じた適切な行動の基礎とはならないだろう。

- 一次元的な目標機能で社会をコントロールすることは、より多くの紛争を引き起こし、それ故に安全が失われることになる。金融システムで見られたような深刻な不安定さを予想しなければならないだろう。

このような社会のコントロールは、自己責任の市民から下僕としての個人へと目を向けさせ、Feudalism 2.0へと導くだろう。これは、民主主義の価値観とは正反対のものである。したがって、今こそ啓蒙主義2.0が必要であり、それはデジタルな自己決定を基盤とする民主主義2.0につながるものである。そのためには、民主的な技術、すなわち民主主義の原則に適合した情報システムが必要であり、さもなければ我々の社会を破壊してしまうだろう。

「ビッグ・ナッジング」-問題解決のための非デザイン的なもの

大量のデータを持つ者は、微妙な方法で人を操ることができる。しかし、慈悲深い意思決定者であっても、正しいことよりも間違ったことをする可能性があると、ダーク・ヘルビングは言う。

ナッジングの支持者は、人々は最適な意思決定をしていないため、彼らを助けることが必要であると主張している。この考え方の学派はパターナリズムとして知られている。しかし、ナッジングは、人々に情報を提供し、説得する方法を選択することはない。むしろ、私たちをある行動に導くために、心理的な弱点を利用する、つまり、私たちはだまされるのである。このアプローチの根底にある科学的アプローチは「行動主義」と呼ばれるが、実はこれはとっくに時代遅れなのだ。

数十年前、バーフス・スキナーは、ネズミやハトや犬を報酬と罰によって条件づけた(例えば、餌を与えたり、痛みを伴う電気ショックを与えたり)。今日、人は同じような方法で人間を条件付けようとする。スキナーの箱の中ではなく、私たちは「フィルターバブル」の中で生活しているのだ。パーソナライズされた価格によって、例えば、インターネット上での(望まない)クリックに対して、罰や報酬が与えられることさえある。ナッジングとビッグデータの組み合わせは、「ビッグナッジング」と呼ばれる新しい形のナッジングにつながっている。私たちに関する個人情報の量は増え続け、多くの場合、私たちの同意なしに収集され、私たちが何を考え、どう感じ、どのように操作できるかが明らかになる。このような内部情報を悪用して、私たちは、そうでなければしないような選択をするように、高価な製品や必要のないものを買うように、あるいは特定の政党に投票するように、操作されるのである。

しかし、ビッグ・ナッジングは、私たちの問題の多くを解決するのに適しているとは言えない。これは特に、私たちの世界の複雑性に関連した課題に対して言えることだ。すでに90カ国がナッジングを利用しているが、私たちの社会的な問題を減らすことはできていない。地球温暖化は進行している。世界平和はもろく、テロは増加の一途をたどっている。サイバー犯罪は爆発的に増加し、経済危機や債務危機は多くの国で解決されていない。

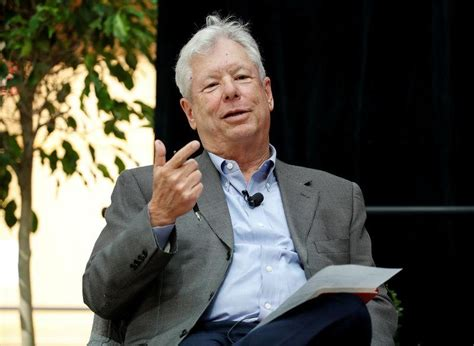

また、Nudgingの第一人者であるRichard Thalerが最近認めたように、金融市場の非効率性を解決する方法はない。彼の考えでは、もし国家が金融市場をコントロールするならば、それはむしろ問題を悪化させるだろう。

しかし、それならなぜ、金融市場よりもさらに複雑な社会をトップダウンでコントロールしなければならないのだろうか。社会は機械ではないし、複雑なシステムを車のように操縦することはできない。このことは、もう一つの複雑なシステムである私たちの身体について議論することで理解することができる。病気を治すには、適切な薬を適切な時期に適切な量だけ服用する必要がある。また、多くの治療法には重大な副作用や相互作用がある。もちろん、ビッグ・ナッジングによる社会的介入にも同じことが期待される。何が社会にとって良いことなのか、悪いことなのか、事前にわからないことが多い。心理学の科学的成果の6割は再現性がない。したがって、Big Nudgingによって、良いことよりも悪いことが起こる可能性が高い。

しかも、万人にとって良い対策というのはない。例えば、ここ数十年、食品に関する注意事項がころころと変わっているのを目にする。また、食物不耐症に悩む人も多く、命にかかわることもある。ある種の癌やその他の病気の集団検診は、間違った診断による副作用がしばしば利益を上回るため、現在かなり批判的に見られている。したがって、もしビッグ・ナッジングを利用するのであれば、確かな科学的根拠、透明性、倫理的評価、民主的統制が本当に重要であろう。行われる措置は統計的に有意な改善を保証するものでなければならず、副作用は許容できるものでなければならない。ユーザーは、(医学のリーフレットのように)それらを認識させるべきであり、治療された人が最後の言葉を持たなければならないだろう。

また、1つの同じ対策を母集団全体に適用するのは良くない。しかし、適切な個別対策を講じるには、あまりにも多くのことが分かっていない。社会では、多様性を維持するために様々な処置が重要であるだけでなく、相関関係(どのような状況でどのような処置をとるか)も重要である。社会が機能するためには、人々がそれぞれの状況に応じて適切な役割を果たすことが不可欠だ。ビッグ・ナッジングはこれを実現するには程遠い。

現在のビッグデータによるパーソナライゼーションは、むしろ差別などの新たな問題を生み出している。例えば、健康保険の料金を特定の食生活に依存させると、ユダヤ教徒とイスラム教徒とキリスト教徒、女性と男性で異なる料金を支払わなければならなくなる。このように、新たな問題が山積しているのである。

したがって、Richard Thalerは、Nudgingは有益な方法でのみ使用されるべきであることを強調するのに飽きない。その代表的な例として、GPSを使ったルート案内を挙げている。しかし、これはユーザーによってオン・オフされるものである。また、ユーザーはそれぞれのゴールを指定する。すると、デジタルアシスタントはいくつかの選択肢を提示し、ユーザーはその中から自由に選択することができる。その後、デジタルアシスタントは、ユーザーがゴールにたどり着き、より良い判断ができるよう、できる限りサポートする。これは確かに人々の行動を改善するための正しいアプローチだろう。しかし、今日のビッグナッジングの精神は、これとは全く異なっている。

「コピーを取る権利 」によるデジタル自己決定権

エルンスト・ハーフェン著

ヨーロッパは、市民が自分に関するすべてのデータのデジタルコピーを受け取る権利(Right to a Copy)を保証しなければならない、とErnst Hafenは言う。 データ民主主義への第一歩は、企業の株主ではなく、市民が所有する個人データの協同組合バンクを設立することだ。

医療は健康データから利益を得ることができる。しかし、個人データへのアクセスは、その人(データ対象者)自身が管理しなければならない。コピーする権利」は、そのようなコントロールの基礎を形成する。

ヨーロッパでは、私たちは自由で民主的な社会に住んでいることを指摘したいと思う。しかし、私たちはほとんど無意識のうちに多国籍データ企業に依存するようになり、その無料サービスの対価を自らのデータで支払うようになっている。個人情報は「新しい資産クラス」あるいは「21世紀の石油」とも呼ばれ、大いに注目されている。しかし、パーソナル・データは様々なデータセットに分散しているため、これまで誰もその最大限の活用を試みていない。GoogleやFacebookは、私たちの健康状態について医師よりも詳しいかもしれない。しかし、これらの企業でさえ、私たちのデータをすべて収集することはできない。なぜなら、彼らは当然、患者のファイルや買い物のレシート、ゲノムの構成に関する情報にはアクセスできないからだ。他の資産とは対照的に、データはほとんどコストをかけずにコピーすることができる。すべての人は、自分の個人データのコピーを入手する権利を持つべきである。そうすれば、自分のデータの使用と集計を管理し、友人や別の医者、科学者コミュニティにアクセスを許可するかどうかを自分で決めることができる。

モバイルヘルスセンサーとアプリケーションの出現は、患者が医療に多大な貢献をすることを意味する。スマートフォンで自分の体の健康状態、例えば医療指標や薬の副作用などを記録することで、重要なデータを提供し、治療の適用状況や医療技術の評価、一般的な根拠に基づく医療を行うことが可能になる。また、国民が自分のデータのコピーにアクセスし、医学研究に参加できるようにすることは、命を救い、医療をより安価にするための道徳的義務である。

ヨーロッパ諸国は、スイスで提案されているように、「コピーする権利」を憲法に明記することで、市民のデジタル自己決定を銅締めする必要がある。そうすれば、市民は自分のデータを使って、グローバルなデータ経済の中で積極的な役割を果たすことができるようになる。自分のデータのコピーを、市民が管理する非営利の協同組合機関に保管することができれば、個人データの経済的価値の大部分を社会に還元することができる。協同組合は、会員のデータを管理する受託者として機能することになる。その結果、パーソナルデータの市場が民主化され、デジタル依存が解消されることになる。

民主的デジタル社会

市民が積極的に参加できるようにすること

バーゼル大学のブルーノ・S・フライは、未来のテクノロジーに責任を持って対処するためには、私たち一人ひとりが意思決定のプロセスに参加することが必要だと主張している。

責任あるイノベーションを効果的に推進するにはどうすればよいのだろうか。人間の相互作用を形成する制度やルールが、人々がその要求に応えられるようなインセンティブを与え、可能にするように設計されていなければ、国民への訴えは、たとえ効果があったとしてもほとんど意味を持たない。

いくつかのタイプの制度が検討されるべきである。最も重要なことは、補完性の原則に従って、社会が分権化されることだ。3つの次元が重要である。

- 空間的分権は、活力ある連邦制からなる。州、地域、コミューンは十分な自治権を与えられなければならない。地方、地域、コミューンは、独自の税率を設定し、独自の公共支出を管理できるようにしなければならない。

- また、公共支出の分野(例えば、教育、保健、環境、水供給、交通、文化など)に応じた機能的な分権も望ましいとされる。このコンセプトは、FOCJ(Functional, Overlapping and Competing Jurisdictions)という提案を通じて発展してきた。

- 行政(政府)、立法(議会)、裁判所の間の権力分立に関連する政治的分権。公共メディアとアカデミアがさらなる柱となるべき。

このような分散化は、これからのデジタル社会で大きな意味を持ち続けるだろう。

また、特定の問題については、国民投票によって国民が直接意思決定に参加する機会が必要である。そのような国民投票に先立つ議論では、すべての関連する議論が整理された形で提示され、述べられる必要がある。ある問題を解決するための様々な提案を比較し、最も有望と思われるものに絞り込み、調停の過程で可能な限り統合する必要がある。最後に、地域の実情に合った最も実行可能な解決策(有権者の多様な支持を得られるという意味で実行可能)を特定するために、住民投票を実施する必要がある。

現在、オンライン審議ツールは、このようなプロセスを効率的にサポートすることができる。これにより、より多くの、より多様なアイデアや知識を検討することが可能となり、「集合知」を活用することで、より良い政策提言が生み出されるようになった。

10の提案を実現するもう一つの方法は、新しい異例の制度を作ることだ。例えば、すべての公的機関に「ディアボリ擁護者」を置くことを義務付けることが考えられる。この擁護者は、各提案に対する反論や代替案を作成することを任務とする。そうすれば、「ポリティカル・コレクトネス(政治的な正しさ)」に沿って考える傾向が弱まり、問題に対する型破りなアプローチも検討されるようになるだろう。

もう一つの異例の措置は、談話の過程で合理的と思われる選択肢の中からランダムな意思決定メカニズムを用いて選択することだ。このようなアプローチにより、型破りで、一般に無視されがちな提案やアイデアが、未来のデジタル社会に統合される可能性が高まる。

ブルーノ S. フレイ

バーゼル大学経済学・幸福度研究センター(CREW)客員教授。また、チューリッヒの経済・経営・芸術研究センター(CREMA)の研究ディレクターでもある。

民主的なテクノロジーと責任あるイノベーション

テクノロジーが私たちの世界の見方を決定するとき、そこには誤用や欺瞞の脅威がある。したがって、イノベーションは私たちの価値観を反映したものでなければならないとイェルーン・ヴァン・デン・ホーフェンは主張する。

ドイツは最近、世界規模の産業スキャンダルに見舞われた。この発覚により、最大手自動車メーカーのCEOが辞任し、消費者の信頼は大きく失墜、株価は大幅に下落、自動車産業全体が経済的なダメージを受けることになった。「Made in Germany」ブランドへの深刻なダメージさえ語られた。賠償金の支払いは数十億ユーロにのぼるという。

このスキャンダルの背景には、VWをはじめとする自動車メーカーが、自動車の環境適合性をテストする際の条件を検知できる操作ソフトウェアを使用していた状況がある。そのソフトウエアのアルゴリズムにより、エンジンの挙動を変化させ、テスト時の汚染物質の排気ガス排出量を通常時よりも少なくする。こうして、試験の手順をごまかすのだ。排出ガスが完全に減少するのはテスト時だけで、通常の使用時には発生しない。

21世紀は、技術的にどのように倫理観を実現するかという問題に早急に取り組む必要がある。

同様に、アルゴリズム、コンピュータコード、ソフトウェア、モデル、データは、デジタル社会で私たちが何を見るか、健康保険、金融、政治に関して何を選択するかをますます決定するようになるだろう。これは、経済や社会に新たなリスクをもたらす。特に、欺瞞の危険性がある。

このように、私たちの価値観は、私たちが創り出すものに具現化されていることを理解することが重要だ。そうでなければ、未来の技術設計が私たちの社会の形を決めることになる(「コードは法律である」)。もし、その価値観が利己的であったり、差別的であったり、自由や個人のプライバシーの理想に反していたりすれば、それは私たちの社会にダメージを与えることになる。したがって、21世紀には、倫理的基準をどのように技術的に実現するかという問題に早急に取り組まなければならないのである。この課題は、私たちに「価値のためのデザイン」を求めている。

もし私たちが、デジタル世界を私たちが共有する価値観と一致させるために必要な技術的ツール、科学、制度を開発する動機を欠いているなら、未来は非常に暗く見えるだろう。ありがたいことに、EUは責任あるイノベーションのための広範な研究開発プログラムに投資している。さらに、ルンド宣言とローマ宣言を可決したEU諸国は、イノベーションは責任を持って遂行される必要があると強調している。とりわけ、効率性、安全性、持続可能性といった価値を調和させることができる、社会的な問題に対する知的な解決策の開発にイノベーションを向けるべきであるということだ。真のイノベーションとは、自動車が持続可能で効率的であると人々を欺くことではない。真のイノベーションとは、これらの要求を実際に満たすことができる技術を生み出すことなのである。

デジタルリスクリテラシー

技術には、それをコントロールできるユーザーが必要

ゲルト・ギゲレンツァーは、知能化されたテクノロジーによって脳力が低下するのではなく、子供の頃から脳力を上手にコントロールすることを学ぶべきだと言う。

デジタル革命は、何千ものアプリ、モノのインターネット、世界とのほぼ永久的な接続性など、印象的な可能性の数々を提供する。しかし、その興奮の中で忘れられがちなことがある。それは、革新的なテクノロジーには、それに支配されるのではなく、それをコントロールできる有能なユーザーが必要だということだ。

3つの事例を紹介する。

私の博士課程の学生の一人がコンピュータの前に座り、論文執筆に没頭しているように見える。同時に、彼の電子メールの受信箱は一日中開いている。彼は実際、中断されるのを待っているのである。彼の執筆の流れを見れば、一日のうちに何回中断があったかは簡単にわかる。

アメリカの学生が運転中にメールを書いている。

「メールが来たら、何が何でも見るしかないの。幸い、私の携帯電話は最初にポップアップでメールを表示してくれるので。..運転中にあまり見る必要がないわ」。時速50マイルのスピードで、彼女が携帯電話をちらっと見るのに2秒しかかからないとしたら、彼女は48ヤードも 「ブラインド 」で運転したことになる。その若い女性は、交通事故のリスクを負っている。スマートフォンが彼女の行動を支配しているのである。同様にドイツ人の20~30パーセントが運転中にメールをする。

2014年に行われたインドの議会選挙では、潜在有権者が8億人を超える世界最大の民主主義選挙であり、主要候補者は3人だった。N.モディ、A.ケジリワル、R.ガンディである。ある調査では、未決定の有権者はインターネットの検索エンジンを使って、これらの候補者についてより多くの情報を知ることができた。しかし、参加者はウェブページが操作されていることを知らなかった。あるグループでは、最初のページでモディについて肯定的な項目が多く表示され、後で否定的な項目が表示された。他のグループも、他の候補者について同じような体験をした。このような操作方法は、インターネット上ではよくあることだ。このような操作によって1ページ目に表示された候補者は、未決定の有権者からの得票数が20ポイント増加すると試算されている。

いずれの場合も、人間の行動はデジタル技術によってコントロールされている。コントロールを失うことは今に始まったことではないが、デジタル革命はその可能性を高めた。

私たちに何ができるのか?3つの競合するビジョンがある。ひとつはテクノ・パターナリズムで、(欠陥のある)人間の判断をアルゴリズムに置き換えるというものである。注意散漫な博士課程の学生は、電子メールを読み続け、論文作成ソフトを使うことができる。必要なのは、テーマに関する重要な情報を入力するだけでよいのだ。このようなアルゴリズムは、盗作騒動という厄介な問題を日常化させることで解決するだろう。

まだSFの世界ではあるが、人間の判断はすでに多くの分野でコンピュータプログラムに取って代わられている。例えば「ベビーコネクト」は、身長、体重、授乳回数、おむつ交換の頻度など、赤ちゃんの日々の成長を記録するアプリで、最近では他のユーザーの子供とリアルタイムに比較するアプリも登場している。親にとって赤ちゃんはデータのベクトルであり、普段の様子とのギャップが余計な心配をさせることもある。

2つ目のビジョンは、「ナッジング」と呼ばれるものである。アルゴリズムにすべての仕事をさせるのではなく、人々はしばしば意識することなく、特定の方向に誘導されるのである。インドの選挙に関する実験は、その一例だ。Googleの検索結果の1ページ目が全クリックの約90%を占め、その半分が最初の2つの結果であることもわかっている。この人間の行動に関する知識を利用して、特定の候補者や特定の商材に関するポジティブなものが1ページ目に表示されるように、結果の順番を操作するのである。ドイツのように、ウェブ検索が一つの検索エンジン(グーグル)に独占されている国では、有権者を揺さぶる可能性が無限にあることにつながる。テクノパターナリズムのように、ナッジングが舵を取る。

しかし、3つ目の可能性もある。私のビジョンは、人々がメディアに支配されるのではなく、メディアをコントロールする能力を身につけるという、リスク・リテラシーである。一般に、リスクリテラシーは、健康、お金、現代技術など、リスクに関連する領域への対処方法を知ることに関係している。デジタルリスクリテラシーとは、デジタル技術に依存したり、操作されたりすることなく、デジタル技術を活用できるようになることを意味する。これは、それほど難しいことではない。私の博士課程の学生は、論文の執筆が中断されることなく行えるよう、メールアカウントの電源を朝昼晩の3回だけ入れることを学んだ。

デジタル・セルフコントロールの学習は、子供の頃から学校で、また親が手本として示す必要がある。 父権主義者の中には、人間にはリスク・リテラシーを身につける知能も自己管理能力もないと言って、この考えを否定する人もいるかもしれない。しかし、何世紀も前に同じことが読み書きを学ぶことについても言われたが、現在では工業国の大多数の人が読み書きをできるようになっている。それと同じように、人々はリスクに対してより賢明な対処ができるようになることができる。そのためには、戦略を根本的に見直し、インテリジェントなテクノロジーに置き換えたり、操作したりするのではなく、人に投資する必要がある。21世紀には、パターナリズムやナッジングを減らし、情報に精通し、批判的で、リスクに精通した市民が必要なのである。今こそ、テクノロジーからリモコンを奪い取り、私たちの人生を私たち自身の手で切り開く時なのである。

エシックス公益と人類のためのビッグデータ

データの力は、良い目的にも悪い目的にも使うことができる。Roberto ZicariとAndrej Zwitterは、ビッグデータ倫理の5つの原則を策定した。

イーロン・マスク(Tesla Motors)やビル・ゲイツ(Microsoft)、スティーブ・ウォズニアック(Apple)など、人工知能(AI)の危険性を警告する声は、最近ますます増えてきている。自動化された兵器システムに反対する請願書には20万人が署名し、最近MITが発表した公開書簡では、来るべきデジタル社会への新しい包括的なアプローチを呼びかけている。

ビッグデータも他の道具と同様に、良い目的にも悪い目的にも使われうることを認識しなければならない。その意味で、人権を理由にセーフハーバー協定に反対した欧州司法裁判所の判断は理解できる。

現在、国家、国際機関、民間主体が様々な領域でビッグデータを採用している。ビッグデータから利益を得るすべての人が、その道徳的責任を自覚することが重要だ。そのため、ビッグデータ活用のための倫理的行動規範を普及させることを目的に、「データ・フォー・ヒューマニティ・イニシアチブ」が設立された。このイニシアチブでは、ビッグデータ利用者のための5つの基本的な倫理原則を提唱している。

- 1. 「Do no harm」。今や誰もが残すデジタルフットプリントは、個人、社会集団、社会全体を、ある種の透明性と脆弱性にさらす。ビッグデータから得られる知見にアクセスする者は、第三者に危害を加えてはならない。

- 2.人類の平和的共存を促進するようなデータの利用を保証する。コンテンツの選択とデータへのアクセスは、社会の世界観に影響を与える。平和的共存は、データ科学者がデータへの公平なアクセスを提供する責任を自覚している場合にのみ可能である。

- 3.データを使って、困っている人を助ける。ビッグデータの領域におけるイノベーションは、経済的な利益だけでなく、さらなる社会的な価値を生み出す可能性がある。グローバルなコネクティビティの時代には、困っている人々を支援するための革新的なビッグデータツールを作ることができるようになった。

- 4.自然保護や環境汚染の低減にデータを活用する。ビッグデータ解析の最大の成果のひとつは、効率的なプロセスの開発と相乗効果である。ビッグデータは、そのような手法が健全で安定した自然環境の創造と維持にも利用されてこそ、持続可能な経済・社会の未来を提供することができるのである。

- 5.データを活用し、差別や不寛容をなくし、公正な社会共存のシステムを構築する。ソーシャルメディアは、強化されたソーシャルネットワークを生み出した。これは、公正、平等、正義の原則に基づいて構築されてこそ、長期的な世界の安定につながるものである。

最後に、ビッグデータがもたらす興味深い新しい可能性が、より良い未来につながる可能性があることにも注目したいと思う。「より多くのデータが安価になり、取得と分析に対する障壁が技術によって取り除かれるにつれて、市民目的のために実用的な情報を提供する機会が増えている。これは、ビッグデータの「共通善」の課題と呼ぶことができるかもしれない。”(DataKind社、Jake Porway)。結局のところ、ビッグデータへの転換は、善を行う機会として、またより良い未来への希望として理解することが重要なのである。

測る、分析する、最適化する。知能を持った機械が社会を支配するとき

デジタル時代には、すでにかなりの程度、機械が日常生活を支配している。したがって、個人情報を共有する前にもう一度よく考えるべきだと、専門家の イヴォンヌ・ホフステッターは述べている。

もし、ノルベルト・ウィーナー(1894-1964)がデジタル時代を体験していたら、彼にとっては、そこは豊穣の地であっただろう。「サイバネティクスは情報と制御の科学であり、制御の対象が機械であろうと生物であろうと関係ない」と、サイバネティクスの創始者は1960年にドイツのハノーバーで説明したことがある。歴史上、今日ほど大量のデータや情報が生み出されたことはない。

サイバネティクスは、「すべてはコントロールできる」という強い主張を持つ、ユビキタスな科学である。20世紀、米軍とソ連は軍拡競争をコントロールするためにサイバネティクスを応用した。NATOはいわゆるC3Iシステム(Command, Control, Communication and Information)を配備していたが、これは軍事インフラに対する用語で、言語的にはウィーナーの著書『サイバネティクス』に傾倒している。これは、1948年に出版されたウィーナーの著書『サイバネティックス:動物と機械における制御とコミュニケーション』に言語的に通じるものがある。コントロールとは、機械だけでなく、個人、あるいは軍事同盟、金融市場、あるいは21世紀では選挙民のような社会システム全体を制御することだ。その大前提は、世界をモニタリング下に置き、データを収集することだ。人やモノをInternet ofEverythingに接続することは、サイバネティック制御戦略の入力として必要な大量のデータを取得するための完璧な方法である。

WienerはCyberneticsで、閉ループのフィードバックという新しい科学的概念を提唱した。フィードバックは、例えば、私たちの「いいね!」やオンラインでのコメントなど、デジタル化の主要な概念でもある。ということは、デジタル化はサイバネティックスの最も完璧な実装ということになるのだろうか?スマートデバイスを使うとき、私たちは自分の意図、地理的位置、社会的環境を開示する絶え間ないデータストリームを作り出しているのである。私たちがオンラインでかつてないほど軽率なコミュニケーションをする一方で、その背後では人工知能のエコシステムが進化しているのである。今日、人工知能は、私たちをプロファイリングし、将来の行動に関する結論を導き出すことができる唯一の技術だ。

自動制御戦略、通常は学習機械が、私たちの実際の状況を分析し、より望ましい「最適な」状態に近づけるような刺激を計算するのである。このような制御装置は、ますます私たちの日常生活を支配するようになってきている。デジタルアシスタントのように、彼らは、オプションと威圧的な不確実性の広大な海の中で私たちが意思決定するのを助ける。Google検索でさえも、コントロール戦略である。キーワードを入力するとき、ユーザーは自分の意図を明らかにする。Googleの検索エンジンは、単にベストヒットのリストを提示するのではなく、ユーザーよりもむしろ企業にとって最高の(金銭的)価値を体現するリンクリストを提示す。このように、企業の提供するものを検索結果の一番上に表示することで、Googleはユーザーの次のクリックをコントロールするのである。これは誤用であると欧州連合は主張している。

しかし、逃げ道はあるのだろうか?そう、もし私たちがサイバネティック・ループから 切り離されたならデジタル刺激に反応するのを止めればいいサイバネティクスは、制御可能な相手がループから外れた場合、失敗する。それでも、私たちはデジタル・コントローラーに反応を負う自由がある。しかし、デジタル化がさらに進むと、やがて選択の余地はなくなるかもしれない。それゆえ、私たちは、デジタル時代、特に知的機械の台頭の中で、自由の権利のために新たに戦うことを求められているのである。

ノルベルト・ウィーナー(1894〜1964)にとって、デジタル時代はパラダイスであろう。サイバネティックスの創始者は、1960年にドイツのハノーバーで「サイバネティックスとは、機械や生物を問わず、情報と制御の科学である」と述べたことがある。

サイバネティクスは、ユビキタスな科学として、「すべてはコントロール可能である 」という強い約束をしている。20世紀には、米軍とソ連が軍拡競争をコントロールするためにサイバネティクスを応用した。NATOは、いわゆるC3Iシステム(Command, Control, Communication and Information)を配備していた。これは、ウィーナーの著書『サイバネティクス』に言語的に依拠した軍事インフラの用語である。これは、1948年に出版されたウィーナーの著書『サイバネティックス:動物と機械における制御とコミュニケーション』に依拠した言語学的な用語である。制御とは、機械だけでなく、軍事同盟、NATO、ワルシャワ条約など、個人や社会システム全体をコントロールすることだ。その基本的な要件は統合、データ収集、コミュニケーション人やモノをInternet ofEverythingに接続することは、サイバネティック制御戦略の入力として必要なデータを得るための完璧な方法である。

サイバネティクスでは、クローズドループフィードバックという新しい科学的概念が提唱された。フィードバックとは、例えば「いいね!」を押したり、ネット上でコメントしたりすることだが、これもデジタル化に関連する大きな概念だ。では、デジタル化はサイバネティクスの最も完璧な実装と言えるのだろうか?スマートデバイスを使うことで、私たちは自分の意図や位置情報、社会的環境などを開示する無限のデータストリームを作り出する。私たちがオンラインでかつてないほど軽率なコミュニケーションをする一方で、その背後では人工知能(AI)のエコシステムが進化している。今日、AIは私たちをプロファイリングし、将来の行動に関する結論を導き出すことができる唯一の技術だ。

自動制御戦略、通常は学習機械は、現在の状態を分析し、より望ましい「最適」な状態に近づけるような刺激を計算する。このような制御装置は、ますます私たちの日常生活を支配するようになってきている。このようなデジタルアシスタントは、膨大な選択肢の海や威圧的な不確実性の中で意思決定を行う手助けをする。Google検索でさえも、コントロール戦略である。キーワードを入力するとき、ユーザーは自分の意図を明らかにする。グーグルの検索エンジンは、ベストヒットのリストだけでなく、ユーザーにとってではなく、企業にとっての(金銭的)価値に従ってソートされたリンクのリストも提示す。企業の提供するものを検索結果の一番上に掲載することで、Googleはユーザーの次のクリックをコントロールしているのである。これはGoogleの独占権を悪用したものだと、欧州連合は主張している。

しかし、逃げ道はあるのだろうか?そうだ、サイバネティックのループから切り離し、単にデジタル刺激に反応しなくなればね。サイバネティクスは、制御可能な相手がループから外れた場合、失敗する。私たちは、たとえ困難であっても、データを慎重に扱い、質素であり続けなければならない。しかし、デジタル化がさらに進むと、やがて選択肢がなくなるかもしれない。だからこそ、私たちはデジタル時代の自由のために、特に知的機械の台頭に対抗して、もう一度戦うことが求められているのである。